Gemini Intelligence, Google porta l’AI operativa su Android

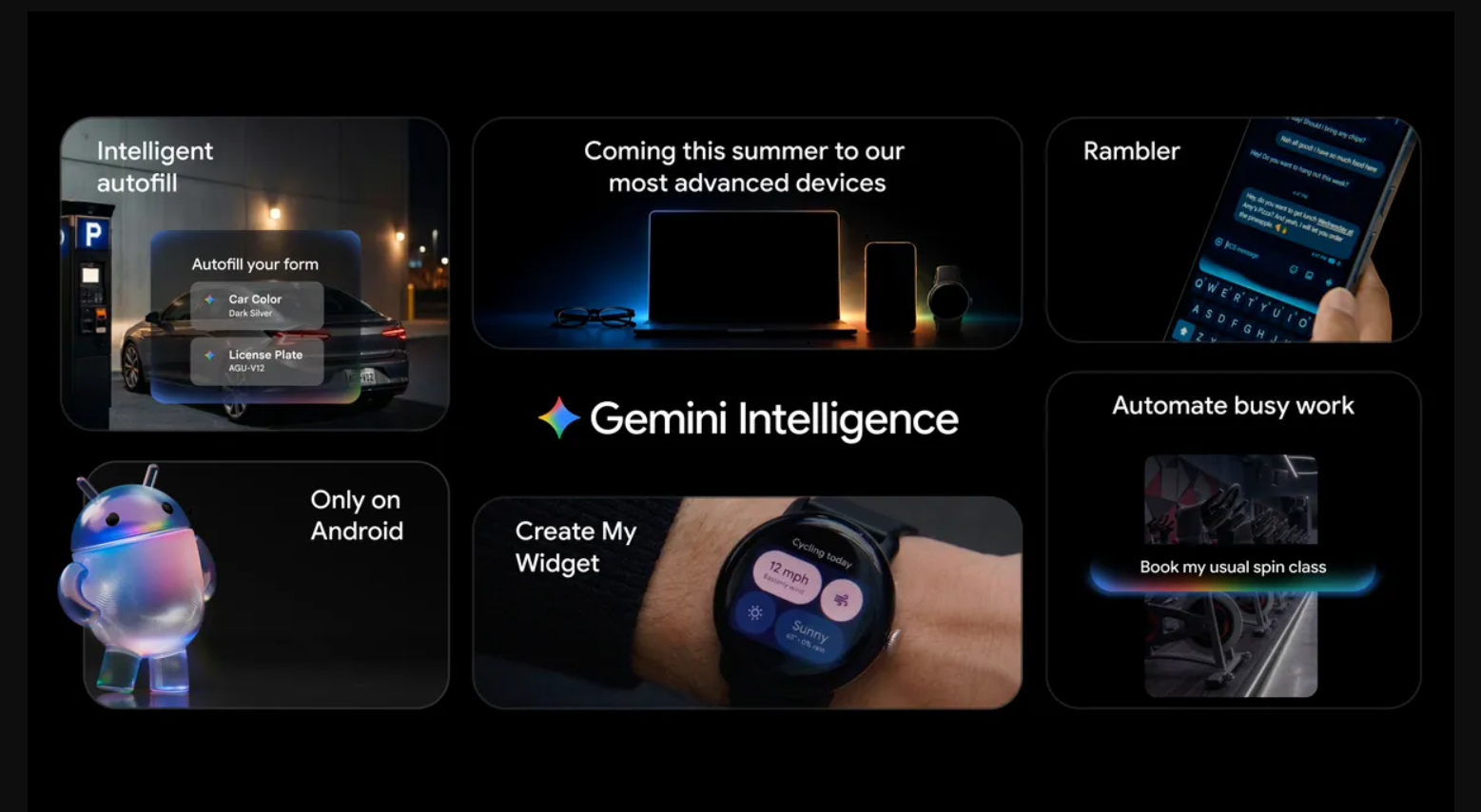

Con Gemini Intelligence, Google prova a trasformare l’intelligenza artificiale mobile in qualcosa di più concreto e quotidiano. Le nuove funzioni promettono di automatizzare attività nelle app, semplificare la compilazione dei moduli, migliorare la dettatura vocale e perfino creare widget personalizzati partendo da un semplice comando testuale. Il debutto partirà in estate su alcuni modelli selezionati, ma l’obiettivo è portare questo approccio su una gamma più ampia di dispositivi Android entro la fine dell’anno.

Con Gemini Intelligence, Google presenta un nuovo pacchetto di strumenti AI per Android pensato per alleggerire parte delle attività ripetitive che oggi richiedono ancora passaggi manuali. L’idea non è limitarsi a rispondere a domande o generare testo, ma portare l’assistente a interagire davvero con il telefono e con le app.

Il rollout inizierà in estate, a partire da Samsung Galaxy S26 e Google Pixel 10. Più avanti, secondo il testo fornito, le stesse funzioni dovrebbero arrivare anche su altri smartphone Android, smartwatch e laptop nel corso dell’anno.

Il punto centrale è che l’AI non resta più confinata in una chat o in un overlay. Con Gemini Intelligence, il telefono dovrebbe diventare capace di eseguire azioni concrete, seguire passaggi in autonomia e ridurre il numero di tocchi necessari per completare attività di tutti i giorni.

Gemini Intelligence automatizza app e attività quotidiane

La novità più importante di Gemini Intelligence riguarda l’automazione delle app. In pratica, l’assistente non si limita più a suggerire cosa fare, ma può muoversi nel telefono per svolgere compiti come prenotare una lezione di allenamento oppure ordinare la spesa.

L’esempio riportato nel testo è molto chiaro. Tenendo premuto il tasto di accensione sopra uno screenshot di una lista della spesa, Gemini può costruire in autonomia il carrello. L’utente può seguire l’avanzamento tramite una notifica e intervenire solo alla fine per confermare l’acquisto.

È un cambiamento importante perché sposta l’AI da una logica consultiva a una logica operativa. Il telefono non si limita più a capire il contesto, ma inizia a tradurlo in azioni dentro le app, riducendo il lavoro manuale soprattutto nelle attività più ripetitive.

Anche la navigazione web riceverà un aggiornamento in questa direzione. A fine giugno, Chrome per Android introdurrà uno strumento di auto browse pensato per attività di routine come la prenotazione di un parcheggio. Parallelamente, anche Autofill su Android verrà potenziato, così da usare il contesto ricavato dalle app per compilare moduli complessi con meno digitazione da parte dell’utente.

Gboard, widget su misura e un AI più utile nel quotidiano

Oltre all’automazione delle app, Gemini Intelligence tocca anche due aree molto presenti nell’uso quotidiano del telefono: la scrittura e la personalizzazione della schermata Home.

Sul fronte della tastiera, Gboard introdurrà una funzione vocale chiamata Rambler. L’obiettivo è rendere più pulita la dettatura, soprattutto per chi tende a usare parole riempitive, fare molte pause o passare da una lingua all’altra mentre parla. Il sistema ripulisce l’audio e lo trasforma in un messaggio più chiaro prima dell’invio.

È una funzione che punta alla praticità più che all’effetto sorpresa. Invece di limitarsi a trascrivere in modo letterale, il sistema interviene per rendere il testo più leggibile e pronto all’uso, riducendo la necessità di correzioni manuali dopo la dettatura.

Un’altra aggiunta interessante è il sistema text-to-widget. L’utente può scrivere un prompt, per esempio chiedendo un widget con una lista settimanale di ricette oppure uno che mostri solo la velocità del vento, e Android costruisce un widget personalizzato per la schermata Home.

Questa funzione amplia il concetto di personalizzazione. Non si parte più solo da modelli predefiniti scelti dagli sviluppatori, ma da una richiesta espressa in linguaggio naturale. Per chi usa molto i widget, è una novità che può cambiare il modo in cui si organizza l’interfaccia.

Privacy, consenso e notifiche sempre visibili

Quando un assistente AI inizia a leggere lo schermo e a interagire con le app, il nodo della fiducia diventa centrale. Google sembra averlo messo al centro della proposta, almeno secondo quanto riportato nel materiale fornito.

Le nuove funzioni di Gemini Intelligence saranno infatti opt-in, quindi attivabili solo con il consenso dell’utente. Inoltre, l’azienda afferma di usare ambienti sicuri per elaborare i dati coinvolti in queste interazioni.

Ci sarà anche un aggiornamento del Privacy Dashboard di Android, pensato per mostrare con precisione quali app sono state coinvolte dall’AI nelle ultime 24 ore. È un’aggiunta importante perché rende più leggibile il comportamento dell’assistente e aiuta a capire dove e quando è intervenuto.

Un altro dettaglio rilevante riguarda la trasparenza in tempo reale. Quando l’assistente starà eseguendo operazioni in background, una notifica resterà fissa nella parte alta dello schermo e non potrà essere rimossa con uno swipe. In questo modo l’utente saprà sempre quando il sistema è attivo.

Un Android meno manuale, ma più delicato da bilanciare

Gemini Intelligence mostra con chiarezza la direzione scelta da Google per l’AI mobile: meno dimostrazioni isolate, più funzioni concrete inserite nei flussi quotidiani. Prenotazioni, spesa, moduli, messaggi vocali e widget personalizzati sono tutti esempi di un’intelligenza artificiale che prova a togliere passaggi, non solo a generare contenuti.

La sfida vera sarà trovare il giusto equilibrio tra comodità e controllo. Più l’assistente diventa operativo, più aumenta il bisogno di fidarsi del sistema e di capire cosa sta facendo in ogni momento. Per questo privacy, notifiche persistenti e consenso esplicito non sono dettagli secondari, ma parti essenziali della proposta. Se l’esperienza sarà davvero fluida come promesso, Gemini Intelligence potrebbe segnare uno dei passaggi più concreti nell’evoluzione di Android verso un sistema operativo più automatico e meno dipendente dall’intervento continuo dell’utente.