Google e Apple sotto pressione: app AI “nudify” nei loro store

Le piattaforme di Google e Apple ospitano app basate su intelligenza artificiale che generano immagini sessualizzate di persone senza consenso. Il caso ha acceso un forte dibattito sulla sicurezza degli store digitali e sulla responsabilità delle aziende che li gestiscono.

Queste applicazioni sfruttano modelli di AI generativa. Consentono di trasformare una foto normale in un’immagine che mostra il soggetto senza vestiti o in pose intime. In molti casi basta caricare una foto e attendere pochi secondi. Il risultato appare realistico e difficile da distinguere da uno scatto vero.

Cosa sono le app “nudify”

Le cosiddette app “nudify” usano algoritmi di elaborazione delle immagini. Alcune funzionano come editor fotografici avanzati. Altre applicano tecniche di face-swap su corpi generati artificialmente.

Il problema non riguarda solo l’aspetto tecnico. Queste app permettono di creare contenuti non consensuali. Chiunque può usarle su foto di altre persone, senza autorizzazione. Questo apre la porta a molestie digitali e abusi.

Perché sono finite negli store ufficiali di Google e Apple

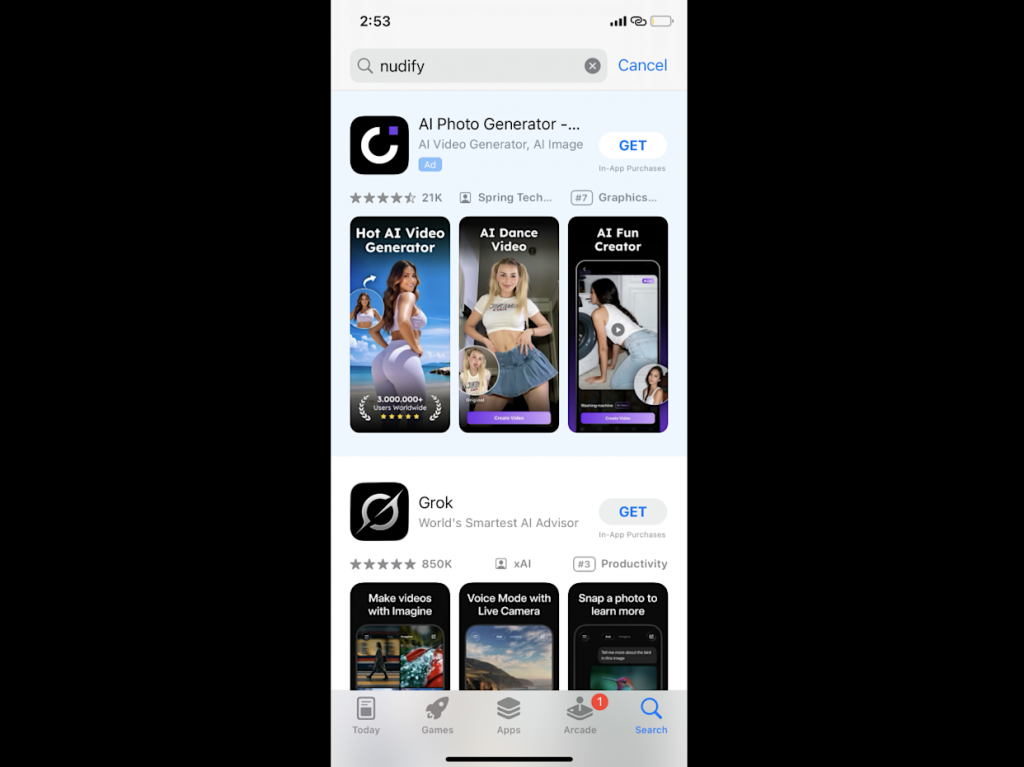

Molte di queste app hanno superato i controlli iniziali. Gli store le hanno pubblicate come semplici strumenti creativi o di modifica immagini. In realtà, la funzione principale era chiara già dalla descrizione.

Le linee guida di Google Play e App Store vietano contenuti sessuali espliciti o degradanti. Tuttavia, questi strumenti sono riusciti a restare online per mesi. Alcuni comparivano persino nei risultati di ricerca con parole chiave dirette.

Questo mostra un limite nei sistemi di revisione. Gli algoritmi di controllo non hanno riconosciuto subito il rischio. Anche la revisione manuale non ha bloccato tutte le app problematiche.

Le reazioni di Google e Apple

Dopo le segnalazioni, entrambe le aziende hanno iniziato a rimuovere molte app. Apple ha cancellato diversi titoli dal proprio store. Google ha sospeso o eliminato varie applicazioni simili.

Non tutte le app, però, sono sparite. Alcune restano disponibili con nomi diversi o funzioni mascherate. Questo rende il problema ancora aperto.

Perché la questione è seria

Queste app possono causare danni reali. Possono generare immagini false di persone comuni, studenti o personaggi pubblici. Il contenuto può poi circolare sui social o nelle chat private.

Il rischio principale riguarda la privacy e la dignità personale. Una tecnologia nata per divertimento può diventare uno strumento di ricatto o umiliazione.

Inoltre, la facilità d’uso abbassa la soglia di accesso. Non servono competenze tecniche. Bastano uno smartphone e una foto.

Cosa può cambiare ora

Il caso spinge Google e Apple a rafforzare i controlli. Servono regole più chiare per le app che usano AI generativa. Serve anche una revisione più severa delle descrizioni e delle funzioni reali.

Allo stesso tempo, aumenta la pressione politica e sociale. Gli store non possono limitarsi a reagire dopo le segnalazioni. Devono prevenire la diffusione di strumenti pericolosi.

Le app AI “nudify” mostrano un lato oscuro dell’intelligenza artificiale consumer. La tecnologia corre veloce. La moderazione deve correre più veloce ancora.