IA responsabile in sanità: tra diagnosi, privacy, bias e sicurezza

L’IA responsabile in sanità promette moltissimo. Può aiutare nella gestione dei percorsi di cura, nel supporto alle decisioni cliniche, nella relazione con i pazienti e anche nelle attività amministrative. Però c’è un punto che oggi pesa più di tutti: l’innovazione, da sola, non basta.

Quando si parla di salute, infatti, un sistema AI non può limitarsi a essere veloce o brillante. Deve essere anche affidabile, controllabile e sicuro. Ed è qui che entra in gioco il tema della IA responsabile in sanità, cioè un modo di progettare strumenti e servizi che metta al centro qualità, privacy, trasparenza ed equità.

Il punto è molto semplice. Se un sistema AI sbaglia il tono di una mail, il danno è limitato. Se sbaglia in ambito clinico, le conseguenze possono essere ben più serie. Per questo il settore sanitario chiede un approccio più rigido, più attento e molto meno improvvisato.

IA responsabile in sanità: perché conta davvero

Nel mondo healthcare, l’AI generativa può migliorare tanti processi. Può velocizzare la documentazione, aiutare nella sintesi di informazioni complesse, supportare la ricerca e offrire strumenti utili a medici, operatori e strutture.

Il problema è che, insieme ai vantaggi, arrivano anche rischi reali. I più noti sono due: allucinazioni e bias. Nel primo caso, il modello produce contenuti plausibili ma sbagliati. Nel secondo, amplifica squilibri già presenti nei dati di partenza.

In sanità, entrambi i problemi pesano tantissimo. Un output falso ma convincente può generare errori di valutazione. Un sistema sbilanciato può penalizzare gruppi di pazienti diversi per età, provenienza o caratteristiche cliniche. Ecco perché parlare di IA responsabile in sanità non è un esercizio teorico: è una condizione necessaria.

La progettazione viene prima di tutto

Uno degli aspetti più importanti è questo: la responsabilità non si aggiunge alla fine. Va costruita all’inizio, nella fase di design.

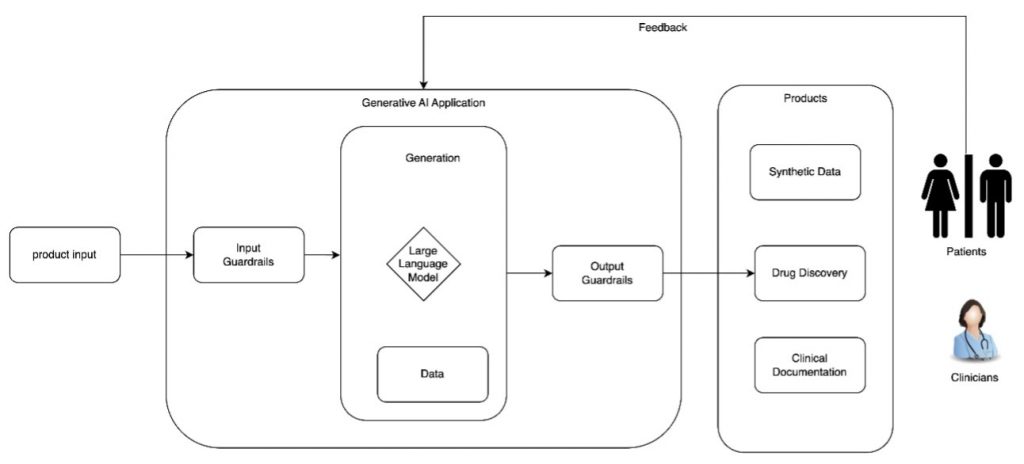

Significa definire regole chiare su input e output, stabilire limiti operativi, inserire controlli, prevedere supervisione umana e decidere in anticipo come il sistema deve reagire in contesti sensibili. In pratica, serve progettare l’applicazione sapendo già dove può sbagliare e come ridurre quel rischio.

Questo approccio cambia molto le cose. Non si tratta più di prendere un modello linguistico potente e buttarlo dentro un flusso sanitario. Si tratta invece di costruire un sistema che sappia lavorare entro confini chiari e verificabili.

Guardrail, controlli e supervisione umana

Quando si parla di AI in medicina, una parola torna spesso: guardrail. In pratica sono barriere di protezione che filtrano richieste, controllano risposte e aiutano a limitare errori, contenuti pericolosi o usi impropri.

Il principio è semplice. L’utente inserisce una richiesta, il sistema la controlla, il modello lavora, poi anche l’output viene verificato prima di arrivare alla fase finale. Questo doppio passaggio può ridurre rischi legati a privacy, sicurezza e qualità del contenuto.

Ma non basta. Serve anche una supervisione umana reale. In un contesto clinico, l’AI non può diventare un decisore autonomo fuori controllo. Deve restare uno strumento di supporto, dentro un processo in cui la responsabilità finale resta alle persone.

Privacy e sicurezza sono centrali

Nel settore sanitario, i dati non sono semplici informazioni. Sono dati personali, sensibili e spesso molto delicati. Per questo la IA responsabile in sanità deve includere una protezione forte della privacy.

Qui entrano in gioco il rilevamento delle informazioni identificabili, la difesa dagli attacchi via prompt, il controllo degli accessi e il monitoraggio continuo del sistema. Non basta che il modello funzioni bene: deve anche trattare i dati nel modo corretto.

È un punto che molte aziende sottovalutano quando raccontano l’AI come magia pronta all’uso. In sanità la magia non serve. Servono regole, verifiche e processi robusti. Più il sistema è potente, più deve essere governato bene.

Governance, test continui e trasparenza

Un altro tema chiave è la governance. Ogni applicazione AI in ambito healthcare dovrebbe avere policy chiare, processi di valutazione e misurazioni costanti del rischio.

Questo vuol dire fare test completi, usare attività di red teaming, raccogliere feedback, aggiornare i controlli e documentare limiti e comportamenti del sistema. Vuol dire anche spiegare bene che cosa lo strumento può fare e che cosa non può fare.

La trasparenza, qui, non è solo una bella parola. Aiuta a costruire fiducia, facilita gli audit e rende più semplice correggere i problemi quando emergono. Se un sistema resta opaco, diventa molto più difficile usarlo in modo serio dentro un ambiente clinico.

IA responsabile in sanità e scienze della vita: il nodo è la fiducia

Alla fine, tutto ruota attorno a una parola: fiducia. Medici, pazienti, strutture e operatori accetteranno davvero questi strumenti solo se li percepiranno come utili, sicuri e governati con criterio.

L’AI può migliorare molti aspetti dell’assistenza sanitaria. Può aiutare la qualità delle cure, l’efficienza dei processi e anche l’esperienza del paziente. Però questo potenziale diventa reale solo se la progettazione segue principi chiari e se ogni fase, dallo sviluppo alla messa in produzione, viene trattata con serietà.

Per questo la vera sfida non è solo portare più AI nella sanità. La sfida è portare IA responsabile in sanità, cioè tecnologie che non inseguano soltanto la potenza, ma sappiano meritarsi fiducia sul campo.