Google TurboQuant riduce la memoria AI

Google TurboQuant è una delle novità più interessanti emerse in queste ore sul fronte AI. Google Research ha presentato questa nuova tecnica come una soluzione al problema della memoria durante l’inferenza dei modelli linguistici, in particolare quando crescono le finestre di contesto. Il punto chiave è semplice: TurboQuant promette di ridurre di almeno 6 volte la memoria necessaria per la KV cache, con picchi di velocità fino a 8x su alcune configurazioni, senza perdita di accuratezza nei test mostrati da Google.

Qui però serve una distinzione importante: non si parla della memoria totale usata da un intero sistema AI in ogni sua parte, ma soprattutto della key-value cache, cioè uno dei colli di bottiglia principali nei modelli di grandi dimensioni quando devono gestire contesti lunghi. È proprio su questo punto che Google sostiene di aver trovato un miglioramento molto forte.

Google TurboQuant: cosa fa

Secondo Google Research, TurboQuant è un algoritmo di compressione “training-free”, quindi non richiede di riaddestrare o rifinire il modello per funzionare: l’idea è comprimere in modo molto spinto la KV cache fino a 3 bit, mantenendo però la qualità delle risposte. Nei benchmark citati, la tecnica viene descritta come capace di preservare l’accuratezza su test di long-context e retrieval con modelli open source come Gemma e Mistral.

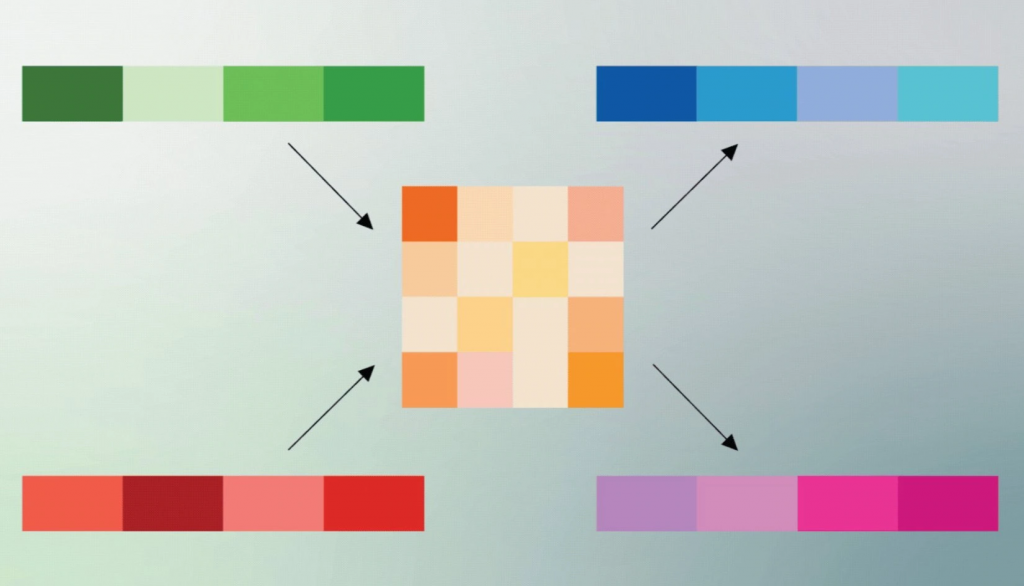

Google ha spiegato che il sistema nasce dalla combinazione di più tecniche, in particolare PolarQuant e Quantized Johnson-Lindenstrauss (QJL), usate per comprimere meglio i vettori e correggere l’errore senza introdurre l’overhead tipico di altre soluzioni. Detto in modo più semplice: non è una singola scorciatoia, ma un pacchetto di idee matematiche pensate per ridurre il peso della memoria senza rovinare i risultati.

Perché Google TurboQuant può essere fondamentale

Il motivo è questo: la memoria è diventata uno dei limiti più pesanti nell’AI moderna. Più si allunga il contesto, più cresce il costo della KV cache, e questo mette pressione su GPU, infrastruttura e costi operativi. Se davvero TurboQuant riesce a comprimere quella parte in modo così netto, allora può rendere più leggera l’inferenza di modelli grandi e, almeno sulla carta, anche più economica.

È anche per questo che la notizia ha avuto effetti immediati sul mercato. Dopo l’annuncio di Google, diversi titoli legati alla memoria e allo storage hanno subito pressione, perché una parte del settore ha letto TurboQuant come una possibile minaccia alla domanda futura di memoria per l’AI.

Non significa che Google abbia risolto la crisi di RAM

Vari analisti hanno già ridimensionato l’effetto della notizia, spiegando che la compressione riguarda soprattutto la KV cache e non elimina il bisogno complessivo di memoria avanzata, in particolare della HBM usata nei sistemi AI più spinti. Inoltre, una maggiore efficienza può anche portare a più utilizzo, non per forza a meno domanda complessiva di hardware.

Google TurboQuant non va visto come la fine del problema memoria, va visto piuttosto come un passo molto interessante verso modelli più efficienti. Ed è proprio questa la parte più credibile della storia. Migliorare un collo di bottiglia reale senza dover sacrificare qualità o rifare il training del modello.

Cosa ci dice questa novità

Google non ha presentato l’ennesima promessa generica sull’AI, ma una tecnica molto precisa che agisce su un problema concreto dell’inferenza moderna. Se i risultati reggeranno anche fuori dai benchmark mostrati finora, Google TurboQuant potrebbe avere un impatto forte sul modo in cui si fanno girare modelli lunghi e complessi nei datacenter e, col tempo, anche su dispositivi più piccoli.

Quindi sì, il tema della crisi della RAM non sparisce da un giorno all’altro. Però Google TurboQuant sembra uno dei segnali più concreti visti di recente sul fronte dell’efficienza. E in questo momento, per l’AI, è già parecchio.